2021

08-08

08-08

Pytorch反向传播中的细节-计算梯度时的默认累加操作

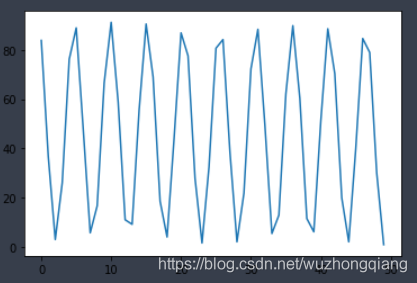

Pytorch反向传播计算梯度默认累加今天学习pytorch实现简单的线性回归,发现了pytorch的反向传播时计算梯度采用的累加机制,于是百度来一下,好多博客都说了累加机制,但是好多都没有说明这个累加机制到底会有啥影响,所以我趁着自己练习的一个例子正好直观的看一下以及如何解决:pytorch实现线性回归先附上试验代码来感受一下:torch.manual_seed(6)lr=0.01#学习率result=[]#创建训练数据x=torch.rand(20,1)*10y=...

继续阅读 >

Pytorch反向传播计算梯度默认累加今天学习pytorch实现简单的线性回归,发现了pytorch的反向传播时计算梯度采用的累加机制,于是百度来一下,好多博客都说了累加机制,但是好多都没有说明这个累加机制到底会有啥影响,所以我趁着自己练习的一个例子正好直观的看一下以及如何解决:pytorch实现线性回归先附上试验代码来感受一下:torch.manual_seed(6)lr=0.01#学习率result=[]#创建训练数据x=torch.rand(20,1)*10y=...

继续阅读 >