2021

07-22

07-22

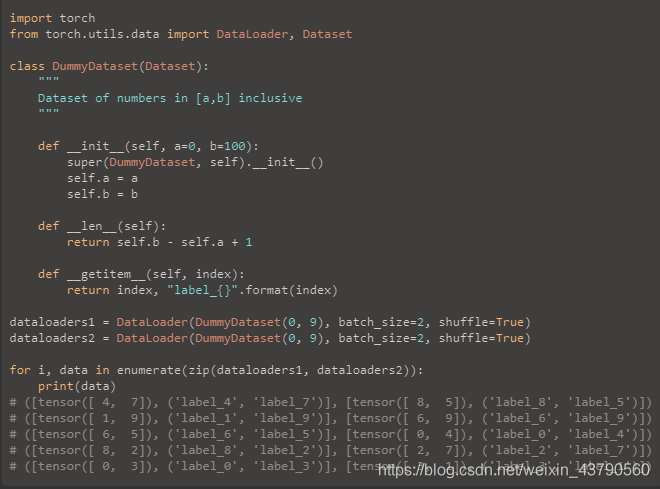

pytorch 实现多个Dataloader同时训练

看代码吧~如果两个dataloader的长度不一样,那就加个:fromitertoolsimportcycle仅使用zip,迭代器将在长度等于最小数据集的长度时耗尽。但是,使用cycle时,我们将再次重复最小的数据集,除非迭代器查看最大数据集中的所有样本。补充:pytorch技巧:自定义数据集torch.utils.data.DataLoader及Dataset的使用本博客中有可直接运行的例子,便于直观的理解,在torch环境中运行即可。1.数据传递机制在pytorch中数据传递按一...

继续阅读 >

看代码吧~如果两个dataloader的长度不一样,那就加个:fromitertoolsimportcycle仅使用zip,迭代器将在长度等于最小数据集的长度时耗尽。但是,使用cycle时,我们将再次重复最小的数据集,除非迭代器查看最大数据集中的所有样本。补充:pytorch技巧:自定义数据集torch.utils.data.DataLoader及Dataset的使用本博客中有可直接运行的例子,便于直观的理解,在torch环境中运行即可。1.数据传递机制在pytorch中数据传递按一...

继续阅读 >