2021

08-08

08-08

Pytorch中Softmax与LogSigmoid的对比分析

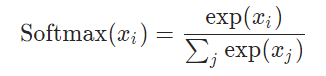

Pytorch中Softmax与LogSigmoid的对比torch.nn.Softmax作用:1、将Softmax函数应用于输入的n维Tensor,重新改变它们的规格,使n维输出张量的元素位于[0,1]范围内,并求和为1。2、返回的Tensor与原Tensor大小相同,值在[0,1]之间。3、不建议将其与NLLLoss一起使用,可以使用LogSoftmax代替之。4、Softmax的公式:参数:维度,待使用softmax计算的维度。例子:#随机初始化一个tensora=torch.randn(2,3)print(a)#输出tensor#初...

继续阅读 >

Pytorch中Softmax与LogSigmoid的对比torch.nn.Softmax作用:1、将Softmax函数应用于输入的n维Tensor,重新改变它们的规格,使n维输出张量的元素位于[0,1]范围内,并求和为1。2、返回的Tensor与原Tensor大小相同,值在[0,1]之间。3、不建议将其与NLLLoss一起使用,可以使用LogSoftmax代替之。4、Softmax的公式:参数:维度,待使用softmax计算的维度。例子:#随机初始化一个tensora=torch.randn(2,3)print(a)#输出tensor#初...

继续阅读 >