2021

08-06

08-06

Pytorch之如何dropout避免过拟合

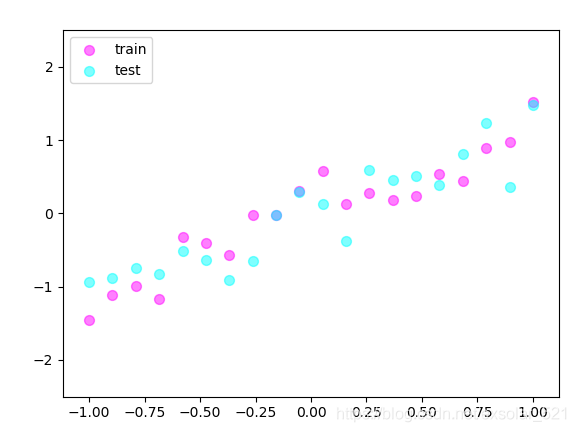

一.做数据二.搭建神经网络三.训练四.对比测试结果注意:测试过程中,一定要注意模式切换Pytorch的学习——过拟合过拟合过拟合是当数据量较小时或者输出结果过于依赖某些特定的神经元,训练神经网络训练会发生一种现象。出现这种现象的神经网络预测的结果并不具有普遍意义,其预测结果极不准确。解决方法1.增加数据量2.L1,L2,L3…正规化,即在计算误差值的时候加上要学习的参数值,当参数改变过大时,误差也会变大,通过这种惩罚...

继续阅读 >

一.做数据二.搭建神经网络三.训练四.对比测试结果注意:测试过程中,一定要注意模式切换Pytorch的学习——过拟合过拟合过拟合是当数据量较小时或者输出结果过于依赖某些特定的神经元,训练神经网络训练会发生一种现象。出现这种现象的神经网络预测的结果并不具有普遍意义,其预测结果极不准确。解决方法1.增加数据量2.L1,L2,L3…正规化,即在计算误差值的时候加上要学习的参数值,当参数改变过大时,误差也会变大,通过这种惩罚...

继续阅读 >

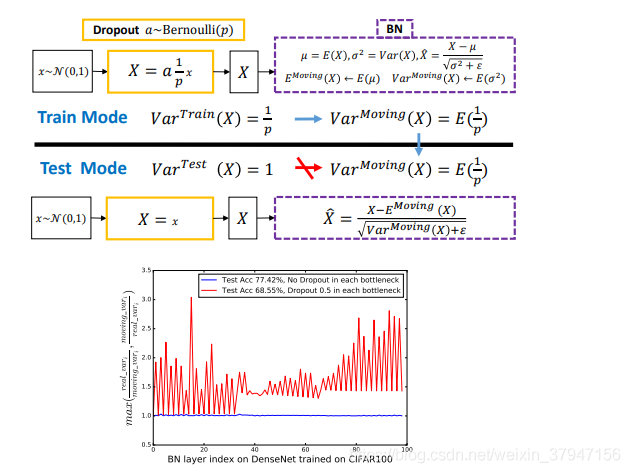

BN与Dropout共同使用出现的问题BN和Dropout单独使用都能减少过拟合并加速训练速度,但如果一起使用的话并不会产生1+1>2的效果,相反可能会得到比单独使用更差的效果。相关的研究参考论文:UnderstandingtheDisharmonybetweenDropoutandBatchNormalizationbyVarianceShift本论文作者发现理解Dropout与BN之间冲突的关键是网络状态切换过程中存在神经方差的(neuralvariance)不一致行为。试想若有图一中的神经响应X...

BN与Dropout共同使用出现的问题BN和Dropout单独使用都能减少过拟合并加速训练速度,但如果一起使用的话并不会产生1+1>2的效果,相反可能会得到比单独使用更差的效果。相关的研究参考论文:UnderstandingtheDisharmonybetweenDropoutandBatchNormalizationbyVarianceShift本论文作者发现理解Dropout与BN之间冲突的关键是网络状态切换过程中存在神经方差的(neuralvariance)不一致行为。试想若有图一中的神经响应X...

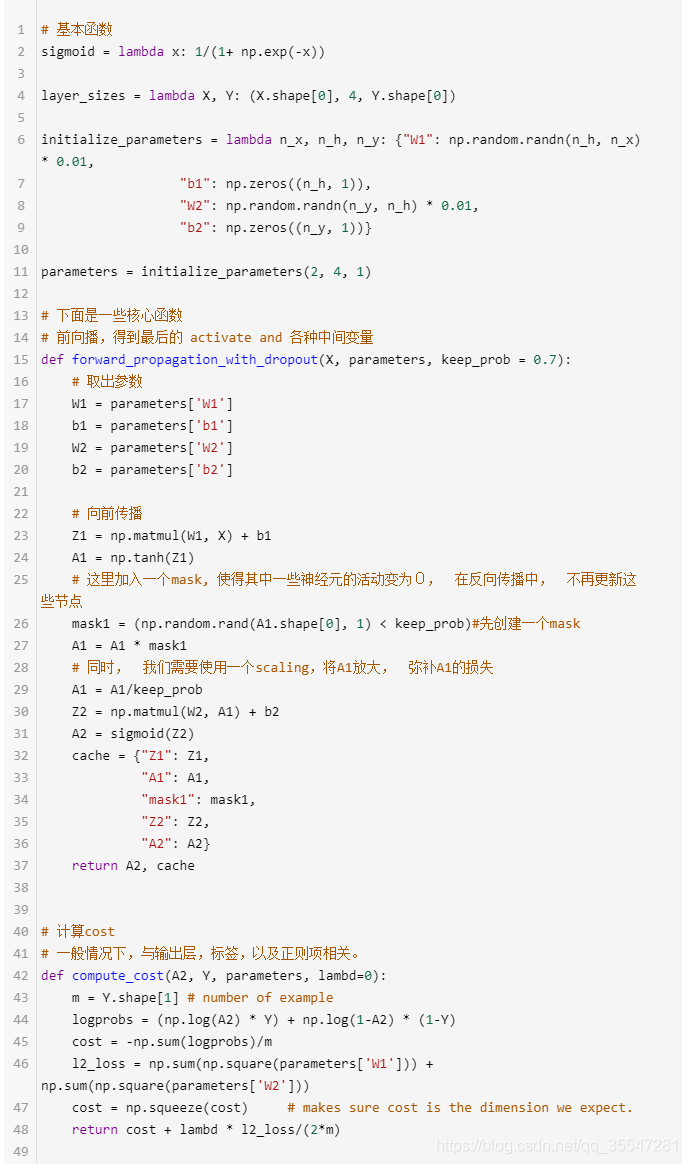

了解知道Dropout原理如果要提高神经网络的表达或分类能力,最直接的方法就是采用更深的网络和更多的神经元,复杂的网络也意味着更加容易过拟合。于是就有了Dropout,大部分实验表明其具有一定的防止过拟合的能力。用代码实现DropoutDropout的numpy实现PyTorch中实现dropoutimporttorch.nn.functionalasFimporttorch.nn.initasinitimporttorchfromtorch.autogradimportVariableimportmatplotlib.pyplotaspltimport...

了解知道Dropout原理如果要提高神经网络的表达或分类能力,最直接的方法就是采用更深的网络和更多的神经元,复杂的网络也意味着更加容易过拟合。于是就有了Dropout,大部分实验表明其具有一定的防止过拟合的能力。用代码实现DropoutDropout的numpy实现PyTorch中实现dropoutimporttorch.nn.functionalasFimporttorch.nn.initasinitimporttorchfromtorch.autogradimportVariableimportmatplotlib.pyplotaspltimport...