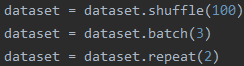

batch很好理解,就是batchsize。注意在一个epoch中最后一个batch大小可能小于等于batchsizedataset.repeat就是俗称epoch,但在tf中与dataset.shuffle的使用顺序可能会导致个epoch的混合dataset.shuffle就是说维持一个buffersize大小的shufflebuffer,图中所需的每个样本从shufflebuffer中获取,取得一个样本后,就从源数据集中加入一个样本到shufflebuffer中。importosos.environ['CUDA_VISIBLE_DEVICES']=""importnum...

继续阅读 >

分类:dataset.shuffle

1.作用dataset.shuffle作用是将数据进行打乱操作,传入参数为buffer_size,改参数为设置“打乱缓存区大小”,也就是说程序会维持一个buffer_size大小的缓存,每次都会随机在这个缓存区抽取一定数量的数据dataset.batch作用是将数据打包成batch_sizedataset.repeat作用就是将数据重复使用多少epoch2.各种不同顺序的区别示例代码(以下面代码作为说明):#-*-coding:utf-8-*-importtensorflowastfimportnumpyasnp...

继续阅读 >

1.作用dataset.shuffle作用是将数据进行打乱操作,传入参数为buffer_size,改参数为设置“打乱缓存区大小”,也就是说程序会维持一个buffer_size大小的缓存,每次都会随机在这个缓存区抽取一定数量的数据dataset.batch作用是将数据打包成batch_sizedataset.repeat作用就是将数据重复使用多少epoch2.各种不同顺序的区别示例代码(以下面代码作为说明):#-*-coding:utf-8-*-importtensorflowastfimportnumpyasnp...

继续阅读 >